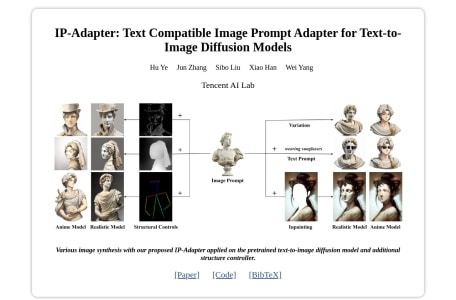

IP-Adapter:用图像提示重构AI作画规则的开源神器

这款插件把你的涂鸦变成了魔法指令

在Stable Diffusion玩家里,最近流传着这么个神奇的故事:只要上传随手画的火柴人,就能生成专业级二次元插画;输入梵高《星夜》截个图,立刻复刻大师风格。这背后藏着腾讯AI实验室的黑科技——IP-Adapter。说通俗点,它就是给AI绘画引擎装了个直读图片指令的”外接大脑”,让创作者能像拼乐高一样组合文字和图像提示。

图像提示技术突破:三招颠覆传统工作流

比起过去要微调模型的费力操作,IP-Adapter带来了三重惊喜:

- 图像融合像吃冰淇淋 支持同时输入5+种参考图,把不同风格搅拌得丝滑柔顺。试过DreamPress的都知道,单一提示生成的图像容易跑偏(想给女朋友生成古风照结果变赛博朋克的社死现场可不少见)。

- 参数体积超mini 22MB的插件包,比表情包还小的体积藏着大智慧。配合Wisdom AI工作流使用时,生成速度完全不输需要3080显卡的笨重模型。

- 兼容生态如鱼得水 现有的ControlNet插件照用不误,深度图控制骨架动作时,图像参考照样生效。就像在PromptBase市场淘到优质提示词后,再叠加自己的创意素材一样爽快。

| 功能模块 | 运行内存 | 效果对标 |

|---|---|---|

| 基础版 | 8GB | Stable Diffusion+3个ControlNet |

| Plus版 | 12GB | Midjourney V5风格一致性 |

用户视角实测:意想不到的彩蛋玩法

上周拿它试做了套表情包,整个过程把我整乐了:

1. 先用美图秀秀画了炸毛猫咪线稿

2. 在输入框贴了宫崎骏《龙猫》剧照+文字”_卡通风”

3. 点击生成后…好家伙!圆滚滚的毛团子带着吉卜力式水彩晕染就出来了

更妙的是插件商店里的隐藏功能:

– 老照片修复模式下,破损的部分用彩色铅笔勾两笔,AI自动补全画面细节(这可比某些收费修复工具良心)

– Cosplay制作时,拿真人的姿态图+动漫角色的设定图拼合,生成效果秒杀影楼修图师

硬件套件:299元解锁完整创作生态

虽说是开源软件,搭配官方硬件套件效果更绝。来看看29.9元的入门包有什么:

| 配件 | 亮点功能 |

|——|———|

|触控灯板|支持压力感应笔触反馈|

|6麦阵列|声纹识别支持角色音色克隆|

|AI主板|离线运行核心算法不卡顿|

想试水的朋友注意:目前没找到免费试用渠道,但GitHub社区有大神做了SD-WebUI插件版。配合Wisdom AI超级工作流使用时,甚至能实现AI生成漫画分镜→自动填色→生成动态PV的流水线作业。

业界怎么看待这个颠覆者?

AI绘画圈这两天炸锅了,Reddit上有开发者吐槽:”这玩意儿把原本需要2000行代码才能实现的风格迁移,简化成了拖拽图片的傻瓜操作。” 确实,对比传统方案,三个维度拉开差距:

1. 生成质量:在包含五要素以上的复杂提示中,画面逻辑保持清晰(不像某些模型会突然长出克苏鲁触手)

2. 创作自由度:支持局部重绘时同步修正prompt,就像在DreamPress上写小说时实时调整插画风格

3. 商业价值:已接入手游公司的角色设计流程,将原画师效率提升3-8倍

当然还有遗憾:目前的1.0版本对3D建模支持有限,期待后续版本加入类似PromptBase上流行的材质映射功能。

相关导航

基于Transformer架构的扩散模型在图像生成质量与运算效率上实现双重突破

Real-ESRGAN

AI图像修复领域的开源突破者

FastGPT

解 FastGPT 核心功能,涵盖智能问答、工作流编排、多模型兼容等优势,提供企业客服、垂直领域知识库等应用场景及搭建指南。

GPT-SoVITS

一款开源的跨语言语音克隆工具,支持5秒样本实时合成,无需编程即可通过WebUI实现专业级语音克隆

腾讯混元大模型 api

腾讯混元大模型通过API开放多模态生成能力,为企业提供智能内容生产全栈解决方案

OmniGen

北京人工智能研究院多任务扩散模型开创者,支持文本/图像/指令混合输入的跨模态创作引擎

Follow Your Pose

通过姿势与文字的双重指引生成可编辑风格化视频

Boximator

用AI重塑视频创作的动态美学

暂无评论...