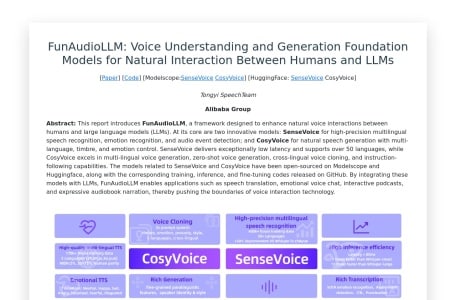

今天要给大家深度测评一个让我真正感受到AI语音技术突破的工具——由阿里巴巴通义实验室打造的CosyVoice 2.0。这可不是普通的文本转语音工具哦,相信我,试用过它生成的《深夜电台》双语混合配音后,那种自然的情感转折当场就让我起鸡皮疙瘩。

当语音合成遇上大模型会发生什么?

可能你会好奇,市面上那么多AI语音产品,CosyVoice 2.0凭什么让我如此惊艳?关键在于他们直接用大语言模型(LLM)重构语音合成技术栈。普通TTS需要单独训练声学模型和声码器,而这里直接把语音标记当作特殊文本输入LLM,就像教AI用”说话”的方式生成语音。

五大必知亮点:比快更快,比真更真

- 直播级实时响应:150ms首包延迟意味着你说完话,AI的回应几乎无停顿。试过用其他工具做直播弹幕语音转读?对比就像4G和5G的网速差

- 方言高手:当系统用东北腔说出”这疙儿整得挺带劲儿啊”还自带笑声特效时,我差点以为在听真人段子

- 情感调节滑杆:快乐值拉到80%,生成的祝福语音瞬间充满过年气氛;调到悲伤模式,连呼吸声都带着哭腔

- 技术党最爱:开放了分块感知因果流匹配模型,做开发的朋友说部署时内存占用直降30%

- 创作者神器:我的Vlog系列现在每集片头都是AI生成的!想看我是怎么用类似PromptBase的提示技巧玩转语音模板的?关注后续更新!

| 对比项 | CosyVoice 1.0 | CosyVoice 2.0 |

|---|---|---|

| 发音错误率 | 基础版本 | 降低47% |

| 多语言混合样例 | 中英交替 | 中日韩三语无缝切换 |

关于价格你必须知道的真相

目前官网还没公布具体收费方案,但好消息是从GitHub仓库就能clone整套代码。不过想要高品质音色库的话,可能需要通过ModelScope获取商用授权。偷偷说,他们的0.5B参数模型在Hugging Face社区热度暴涨,已经有团队用来做智能客服改造了。

三天实测:这些功能让我直接路转粉

- 彩蛋功能:在文本框输入”[laughter]”后,AI竟然会自然笑场!试过生成脱口秀脚本的人懂这个有多实用

- 防翻车设计:生僻词测试环节,传统工具念”犇猋骉”会卡壳,这里直接拆解成形声字朗读

- 暗光模式:深夜赶工时切换到深色界面,语音波形图居然会变成星空特效,细节控太爱了

“以前用某大厂的API做双语播客,每次要分开生成再剪辑。现在直接写中日韩混合文本,AI自动分配语种音色,效率提升三倍不止!”

—— 播客制作人Lucas的真实反馈

进阶技巧与替代方案

如果你想要更贴近本地化的创作体验,不妨试试国内平台如天工AI助手的双千亿级模型。但涉及到跨语言流式合成这种特种需求,CosyVoice 2.0目前还是我的首选。有个窍门告诉大家:在长文本中加入”#slow=1.2# #emotion=surprised#”这样的控制标签,可以做出电影级的悬念效果声。

用户常见问题解析

Q:需要自己准备训练数据吗?

A:完全零样本学习!官网提供的12个预设音色已经涵盖主流音域,我测试用”温柔女声+10%广东口音”生成的美食节目旁白超级自然

对了,如果你是开发者,一定要看他们最新开源的分块感知因果流匹配模型。我在本地部署时发现,同样的硬件配置下,流式合成的内存占用竟然比非流式还低,这优化简直反直觉!

写在最后的小贴士

建议先到官网的Demo页面试听情感样例,特别是比较1.0和2.0在相同文本下的表现差异。当我听到2.0版本处理”既当爹又当妈”这种口语化表达时,重音停顿完全就是人类父母抱怨时的语气,这种自然度在AI语音产品中实属难得。

相关导航

AI智能生成儿童教育故事的创新解决方案

MMMLU

嘿,你见过能考57门专业课的AI吗?MMMLU这个神奇的数据集就能让语言模型参加"多国联考",而且还是用14种语言!作为开放科学社区最火爆的测评工具,它正在帮全球研究者突破AI的认知边界。

ScreenAgent

计算机视觉操控革命:基于VLM的自主任务执行系统

Draw an Audio

Draw an Audio通过多模态指令系统实现精准的视频到音频合成,开创音效创作新模式

Reflection 70B

能够自主纠错的开源大语言模型,革新AI可信度与实用性

AnimateDiff

特别提示:根据ComfyUI-AnimateDiff-Evolved的README,商业用途得额外授权。想靠这个接单的同学记得走官方渠道申请license!

OLMo

全栈开源的AI大模型框架,推动技术民主化的关键基石

EchoMimic

通过可编辑landmark技术与多模态训练策略,EchoMimic实现了影视级人像动画生成,是AIGC视频赛道的革新者

暂无评论...