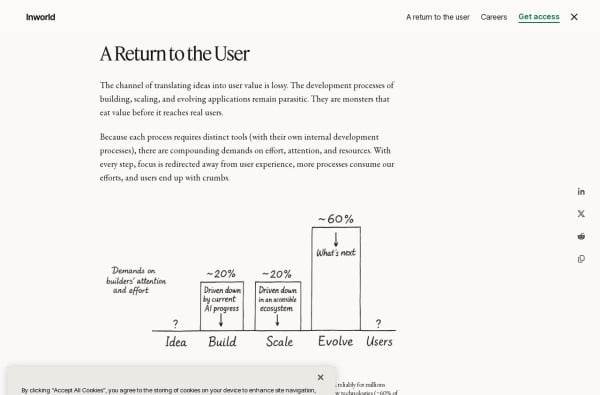

大模型算力困局:成本、功耗、国产化三座大山压顶

当企业试图部署百亿级大模型时,往往陷入三重困境:训练千亿参数模型动辄消耗百万显卡成本,边缘设备跑AI时电池撑不过半天,政府金融等关键领域还面临算力卡脖子风险。这些痛点正在倒逼新一代AI芯片技术突破:

- 算力成本黑洞:千卡集群月耗电费≈中型工厂,推理环节80%算力浪费在无效计算

- 功耗死亡红线:车载/安防设备跑Transformer,传统方案功耗>50W,散热直接崩盘

- 国产化焦虑:金融政务系统迁移大模型,合规要求倒逼全栈自研替代方案

为破此局,四款颠覆性算力方案已杀入战场:

| 工具名称 | 核心优势 | 适用场景 |

|---|---|---|

| 燧原科技官网 | 千卡集群不掉链子|全栈国产替代 | 百亿级大模型训练|金融政务系统 |

| Cerebras Systems官网 | 单卡训练巨兽|能效提升6倍 | 科研级大模型|生物计算 |

| 后摩智能官网 | 存算一体架构|功耗<8W | 车载智能驾驶|安防边端设备 |

| 墨芯人工智能官网 | 稀疏计算省70%显存|推理延迟<2ms | 云端模型部署|移动端AI应用 |

硬核国产算力担当——燧原科技,一块AI芯片卷动整个大模型生态

老哥们别只盯着英伟达,国产AI芯片现在也能打!燧原科技这家伙直接把训练、推理、软件栈打包成一条龙,连狗屁算力焦虑都给治好了,堪称国产AI芯片界的“扛把子”。

主要功能

- 训练加速卡:自家邃思芯片跑千卡集群,GPT级别的大模型训练不掉链子。

- AI芯片:7nm工艺,128GB HBM,硬核算力直接顶上GPU加速芯片的缺。

- 算力集群:云燧i20一体机即插即用,企业级客户“租”算力比买游戏机还方便。

- 国产替代:指令集、软件栈全自研,合规又安全,政府、金融老铁闭眼入。

真实场景:某银行拿它训完千亿级反欺诈大模型,训练时间从3个月压缩到2周;某省级政务云直接上线,卡都没换人就迁完系统,简直是“国产大模型起飞神器”。

Cerebras Systems——比键盘还大的AI计算芯片,大模型训练“巨兽”

说到疯狂堆料的AI计算芯片,Cerebras绝逼是头号显眼包。这货直接塞了85万个计算核心在一个跟iPad那么大的晶圆上,跑深度学习芯片任务时,别的GPU还在排队,它已经秒杀了。

主要功能

- 超大晶圆级引擎:单卡=一整个晶圆,45分钟跑完GPT-3,效率炸裂。

- 内存开挂:片上40GB SRAM,带宽20PB/s,喂饱模型毫无压力。

- 易用软件栈:CSoft把PyTorch模型一键转WSE指令,研发老哥直呼“基操”。

- 绿色算力:单位瓦特算力≈6张A100,电费直接省掉一大截。

实战栗子:美国阿贡国家实验室用它跑脑科学AI,14天做完原先6个月的计算;某医药独角兽拿它搞蛋白质结构预测,“嗑”药发现速度开挂。

后摩智能——存算一体AI芯片,边端智能的真·续航神器

想在车载、安防端侧塞一颗不吃电的AI芯片?瞅准后摩智能就对了。他们把“存算一体”的骚操作玩到飞起,功耗比传统深度学习芯片直接砍一半,边跑大模型边省电,简直不要太香。

主要功能

- 存算一体芯片:内存跟计算单元零距离,延迟低到0.1ms,边端推理快到没朋友。

- 智能驾驶:支持BEV+Transformer部署在车载域控,跑1000 FPS不费电。

- 边端计算:火柴盒大小模组直接塞进IPC、无人机,本地就能跑大模型。

- AI芯片:14nm工艺,INT8算力50 TOPS,功耗只有8 W。

说人话:某新能源车企靠它把城市NOA下放到15万元车型;头部安防厂用它做行为识别摄像头,电池供电3个月不充电,客户乐疯了。

墨芯人工智能——双稀疏算法加成的AI芯片,大模型推理“省钱狂魔”

做推理部署还在心疼显卡贵?墨芯人工智能这货掏出双稀疏算法,把无用计算一把剪掉,同一颗AI芯片能省掉70%显存、50%算力成本,直接让国产大模型落地不破产。

主要功能

- 双稀疏算法:细粒度+结构化稀疏,模型瘦身不掉精度,推理速度飙到飞起。

- 算力优化:单卡跑175B模型延迟<2ms,GPU加速芯片兄弟们哭晕在厕所。

- AI芯片:28nm工艺,能耗比高达30 TOPS/W,省电费堪比换空调。

- 全栈加速:从稀疏编译器到推理引擎,全部开放API,30分钟完成模型迁移。

用例速览:某头部云厂商拿它扛双十一推荐流量,单卡顶替5张A10;某视频App把超分模型塞进手机端,4K修复直播省流30%,用户狂刷666。

多维算力矩阵闪耀,国产生态赋能加速度

面对多样化的AI算力需求,四大厂商以差异化技术路线精准制导:燧原科技凭国产全栈方案攻克政企合规场景,Cerebras以超大晶圆引擎实现百亿参数级模型破壁,后摩智能用存算一体架构重塑边端智能边界,墨芯人工智能借双稀疏算法重构推理成本模型。以下是不同需求场景下的决策路径:

- 国产替代刚需型:当政务/金融领域要求芯片-软件全合规时,燧原提供从卡到集群的零改造迁移方案,某银行千亿模型迁移仅用2周验证其成熟度

- 超大规模训练场景:Cerebras那块45分钟跑H100的晶圆卡,特别适合天文/制药等领域的大规模并行计算,阿贡实验室实测效能提升超12倍

- 移动边缘计算战场:车载/安防设备对10W级高算力比芯片的需求,后摩智能的火柴盒模组已落地新能源车机,支撑城市NOA下沉到15万价位

- 成本敏感型推理:墨芯的双稀疏重构技术让云厂商在双十一等流量洪峰期,用单卡顶替5张A10的同时节省70%显存,堪称卡位战利器

无论是筑牢数据主权护城河,还是突破算力密度天花板,抑或在功耗/成本/尺寸的螺丝壳里作舞,当前AI芯片市场已呈现显著的技术路线分化红利合适的才是最好的,不存在放之四海皆准的标准答案。

© 版权声明

文章版权归作者所有,未经允许请勿转载。

相关文章

暂无评论...